Dla Facebooka emotikony są passé. Dzięki nowej funkcji, żeby wysłać :-) wystarczy uśmiechnąć się przed kamerą

Badacze Uniwersytetu Południowej Kalifornii oraz dział Facebooka zajmujący się Oculusem zaprezentowali możliwość do sprawdzenia mimiki twarzy osoby korzystającej z okularów wirtualnej rzeczywistości i przeniesienia ich na wirtualnego awatara.

Rozwiązanie to mogłoby znacznie pomóc w pracy, komunikacji oraz graniu w gry za pomocą takich okularów, bo inni doskonale widzieliby, jak reagujemy na inne różnego rodzaju rzeczy. O emocjach nie będziemy nikogo informować wysyłając emotikony, a po prostu wyrażając emocje. Będzie można to zrobić w najbardziej naturalny sposób na świecie.

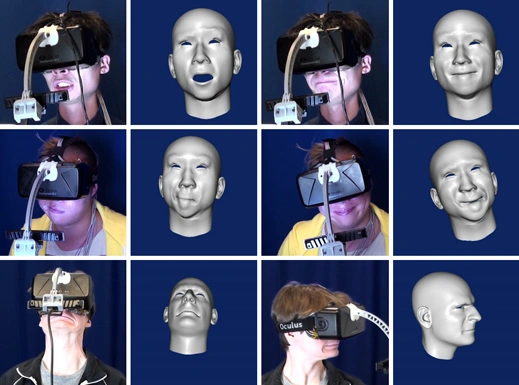

Śledzenie emocji przekazywanych przez dolną część twarzy będzie możliwe dzięki kamerze 3D umieszczonej na krótkim wysięgniku, znajdującej się na przykład w mikrofonie. Z kolei ruchy górnej części możliwe będzie dzięki tensometrom sprawdzającym odkształcenia wyściółki piankowej idealnie dopasowanej do twarzy. Po połączeniu danych z tych dwóch źródeł możliwe będzie stworzenie modelu idealnie odwzorowującego ruchy całej twarzy i przeniesienie ich na wirtualny awatar.

W ten sposób osoby korzystające z wirtualnej rzeczywistości będą mogły tworzyć prawdziwe społeczności.

Nie jest to możliwe bez poznania emocji innych należących do nich ludzi. Doskonale pasuje to do ogólnej wizji Marka Zuckerberga, szefa Facebooka, który powiedział, że jest zainteresowany Oculusem Rift, bo ten umożliwia poznanie nowych dróg do nawiązywania kontaktów przez ludzi z całego świata. Bez wyrażania emocji byłoby to stosunkowo trudne.

Co prawda badacze pracowali nad tą funkcją w ramach edukacyjnych, ale podobno nic nie stoi na przeszkodzie, by w stosunkowo krótkim czasie dopracować ten system i zamienić go w pełnoprawny, komercyjny produkt. Ale to nie pierwsze rozwiązanie tego typu. Nad technologią rozpoznawania mimiki twarzy, ramion i rąk pracuje też startup High Fidelity, którym kieruje Philip Rosedale, założyciel gry Second Lige.

Oznacza to, że wirtualne awatary będą mogły odwzorowywać wszystkie nasze ruchy.

Oczywiście jest to znacznie trudniejsze rozwiązanie, które wymagałoby postawienia kamery na odpowiednim wysięgniku lub skorzystania z zewnętrznego modułu, takiego jak Kinect. Kamera taka może być też umieszczona wewnątrz okularów wirtualnej rzeczywistości i być dobrą alternatywą dla wspomnianych wcześniej tensometrów lub dodatkowo śledzić ruchy gałek ocznych. W końcu człowiek patrzący się cały czas przed siebie wyglądałby co najmniej dziwnie.

Jak na razie oprogramowanie używane w Oculusie wymaga przeprowadzenia kalibracji przy pierwszym korzystaniu z okularów VR. W tym celu należy przez 10 sekund naśladować różne twarze proponowane użytkownikowi przez okulary. W tej części trzeba zdjąć wyświetlacz okularów tak, by kamera 3D mogła uchwycić ruchy całej twarzy. Następnie trzeba założyć wyświetlacz i powtórzyć ćwiczenie. Proces ten może zostać uproszczony, ponieważ osoby pracujące nad projektem starają się dostarczyć algorytmowi danych z wielu różnych twarzy.

Oprócz tego pracują one nad możliwością przeniesienia dokładnego wyglądu twarzy do wirtualnego awatara. To też jest wyjątkowo ciekawe zagadnienie, ale podejrzewam, że wiele osób zdecyduje się stworzyć siebie od nowa niż polegać decydować się na swój codzienny wygląd.