Pełna autonomia dla robotów-zabójców? Ponad 100 państw właśnie debatuje nad tym w Genewie

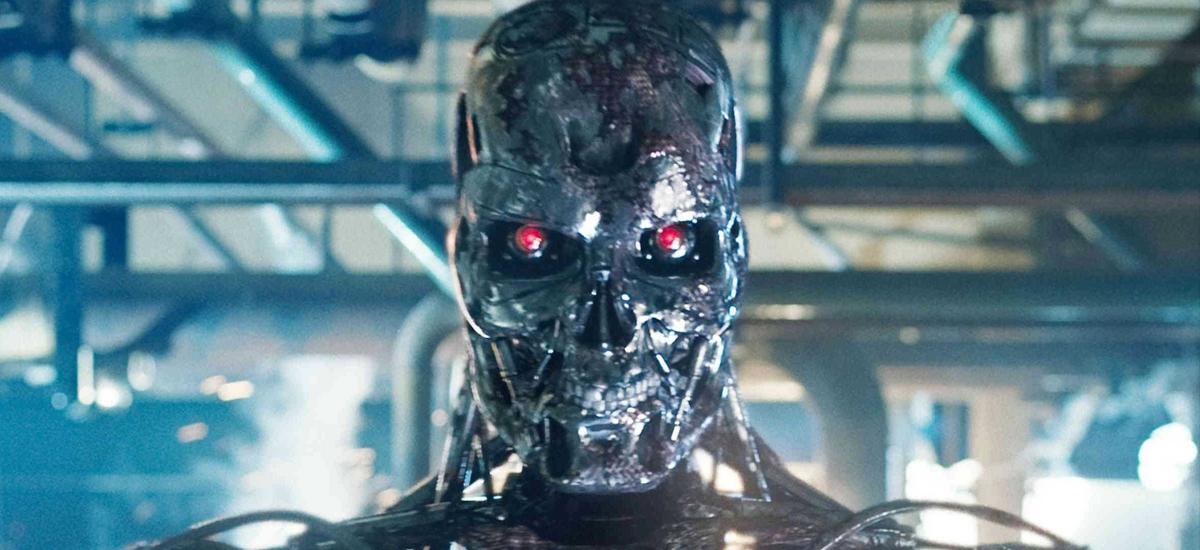

Czy ludzkość powinna dysponować autonomiczną bronią zdolną do odbierania życia? To pytanie może okazać się jedną z najważniejszych kwestii, które będziemy musieli poruszyć w XXI wieku. No i co się stanie, kiedy taka broń powstanie?

Przedstawiciele ponad stu krajów spotkali się dzisiaj w Genewie, żeby o tym porozmawiać. Tak, dzisiaj. Autonomiczne roboty-zabójcy nie są aż tak bardzo odległą wizją, jak może się co poniektórym wydawać. Powstały już nawet organizacje, które sprzeciwiają się autonomizacji broni.

Stop Autonomous Weapons to jedna z takich organizacji. Należy do niej Stuart Russell, profesor z Uniwersytetu Kalifornijskiego w Berkeley, który od ponad 30 lat prowadzi badania na temat sztucznej inteligencji.

Czemu ktoś chciałby zakazać korzystania z autonomicznej broni?

Russel pojawił się na dzisiejszym spotkaniu państw, które podpisały Konwencję o zakazie lub ograniczeniu użycia pewnych broni konwencjonalnych. Wraz z kilkoma innymi przedstawicielami Stop Autonomous Weapons zaprezentował on zgromadzonym dyplomatom poniższy film:

Wizja przyszłości pokazana w filmie jest oczywiście przerażająca. Organizacja Stop Autonomous Weapons chciała pokazać w nim jeden z gorszych scenariuszy, który może nastąpić po stworzeniu autonomicznej broni. W prezentowanym filmie są to małe, latające drony uzbrojone w ładunki wybuchowe.

Ich konstrukcja pozwala im na błyskawiczne reakcje i niezwykłą precyzję. W filmie zaprezentowany jest też fragment prezentacji jakiegoś oprogramowania, dzięki któremu sztuczna inteligencja jest w stanie identyfikować i lokalizować ludzi na podstawie ich cyfrowych odcisków palców.

Zamach przeprowadzony na studentów przy użyciu tej broni jest oczywiście następstwem dostania się jej w jakieś niepowołane ręce.

Russel przestrzegał przedstawicieli 123 państw, które debatowały dzisiaj w Genewie m.in. na temat autonomicznych systemów bojowych, że wprowadzenie tego typu uzbrojenia zmniejszy międzynarodowe, narodowe oraz osobiste poczucie bezpieczeństwa.

Autonomiczna broń coraz bliżej.

Po drugiej stronie tej kwestii spornej stoi wojsko. Już teraz wojskowi dysponują np. algorytmami SI, które potrafią wyszukiwać cele na obrazach z kamery drona o wiele skuteczniej, niż jakikolwiek ludzki obserwator.

Amerykańska agencja badawcza DARPA zbudowała już nawet autonomiczną łódź podwodną, której zadaniem, w przypadku konfliktu zbrojnego, byłoby polowanie na łodzie podwodne przeciwnika. Wojsko jest jednym z najbardziej hojnych mecenasów, jeśli chodzi o finansowanie badań nad sztuczną inteligencją.

Russel nie jest jedynym naukowcem, który protestuje przeciwko wprowadzeniu autonomicznej broni. W sierpniu, Elon Musk i Mustafa Suleyman z Google stanęli na czele 116 specjalistów, którzy apelowali do ONZ o zakaz rozwijania autonomicznej broni. Przeciwnicy porównują jej stworzenie do otwarcia Puszki Pandory.

Politycy na chcą podejmować zbyt pochopnych decyzji.

Amandeep Gill, ambasador Indii, który przewodniczy Konferencji Rozbrojeniowej powiedział prasie, że przed wydaniem jakiegokolwiek zakazu wolałby doprecyzować wszystkie szczegóły dotyczące autonomicznej broni. Gill zaznaczył również, że wszystkie państwa, których przedstawiciele spotkali się w Genewie zgadzają się co do tego, że gdzieś w całym procesie podejmowania decyzji przez autonomiczną maszynę musi pojawić się człowiek.

Podobny pogląd wyraża Międzynarodowy Komitet Czerwonego Krzyża:

Autonomiczne drony-zabójcy będą ogromnym problemem dla sądownictwa i etyki. W jaki sposób rozwiążemy kwestie odpowiedzialności za niezamierzone szkody wyrządzone przez algorytm? Na jak dużą swobodę możemy pozwolić maszynom używanym na pierwszej linii frontu? Czy będą w stanie stosować prawo do konfliktów zbrojnych (łac. ius in bello)?

Na decyzję mamy jeszcze trochę czasu.

Przedstawiciele Stop Autonomous Weapons twierdzą, że ryzyko związane z wprowadzeniem tego typu uzbrojenia przewyższa korzyści. Zdaniem takich ludzi, jak Stuart Russell, Elon Musk, czy Stephen Hawking, autonomiczna broń powinna znaleźć się na przyjętej w 1980 r. i obowiązującej od 1983 r. konwencji o zakazie lub ograniczeniu użycia niektórych rodzajów broni konwencjonalnej.

Osobiście uważam, że trudno wyrobić sobie opinię na rzecz czegoś, co jeszcze nie istnieje. Na pewno chciałbym wysłuchać argumentów obu stron tego sporu. Autonomiczna broń ma swoje wady i zalety. Zakazywanie jej „w ciemno" nie wydaje się być najlepszym rozwiązaniem.