W świecie AI król jest tylko jeden. Google jest już o krok od prawdziwej sztucznej inteligencji

Mnóstwo firm robi świetne telefony i laptopy. Jeszcze więcej potrafi doskonale zaprogramować aplikację. Ale król w świecie AI jest tylko jeden. To Google oczywiście.

Jeśli ktoś miałby jeszcze jakieś wątpliwości na temat tego na czym skupia się Google w swoim planie podbicia świata, to po dzisiejszej prezentacji odpowiedź sama ciśnie się na usta.

- powiedział ze sceny szef Google, Sundar Pichai.

Google jest liderem w pracach nad sztuczną inteligencją. Jakkolwiek dzielą nas od niej jeszcze lata świetlne, przewaga nad resztą stawki wydaje się już zauważalna. Niestety - dla rodzaju ludzkiego - wyścig toczy się w ramach uczenia maszynowego, które jest jedynie namiastką sztucznej inteligencji. Ale na bezrybiu i rak ryba.

Jak Google wyobraża sobie idealne wykorzystanie uczenia maszynowego? Zostało to nakreślone w czterech punktach.

1. Interakcje

Ze sztuczną inteligencją mamy wchodzić w interakcje za pomocą głosu, obrazu i gestów. Wpisywanie komend z klawiatury jak widać nie będzie częścią przyszłości. Nic dziwnego, w końcu większość nowopokazanych urządzeń ekranu nie posiada.

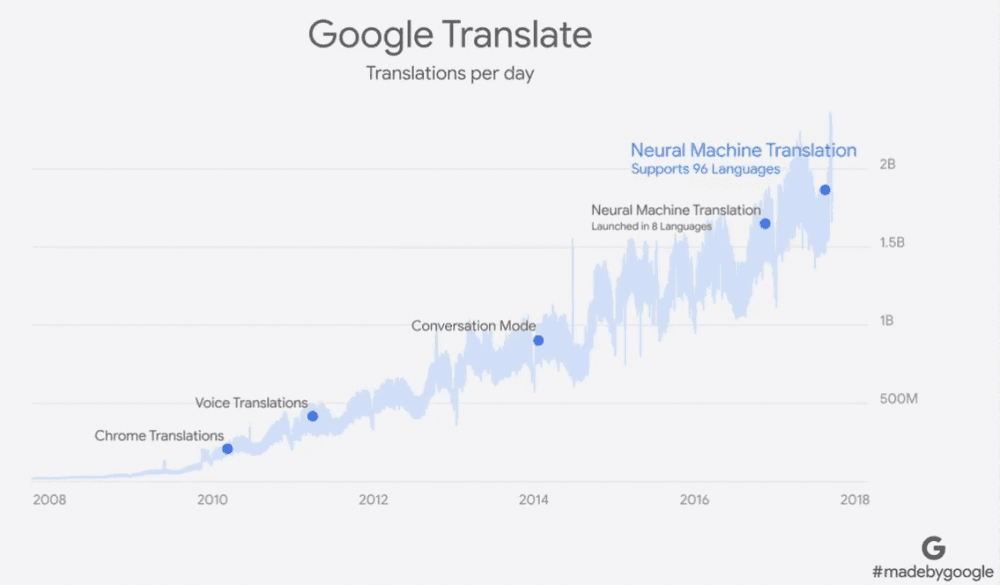

Uczenie maszynowe pomoże urządzeniom w zorientowaniu się czego od nich chcemy i nie zostawi nas samo na wypadek konwersacji z obcokrajowcami. Służyć temu mają słuchawki Pixel Buds, które umożliwią rozmowę w różnych językach w czasie rzeczywistym.

Do wyliczanki Sundara dodałbym jeszcze jeden rodzaj kontaktu z asystentem - przez ściskanie. Wiadomo, że za produkcją Pixeli stoi HTC. Dlatego w obu flagowcach będzie można aktywować asystenta przez ściskanie telefonu - podobnie jak w HTC U11.

2. Wszechobecność

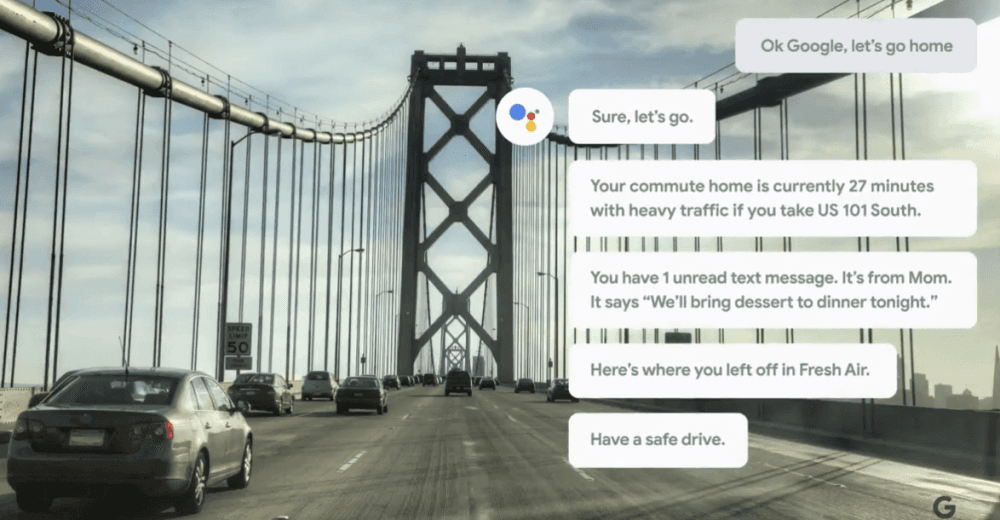

Google Assistant w telefonie, chromebooku, głośniku, telewizorze - dosłownie wszędzie. Tak jak teraz nie pytamy, czy gdzieś jest elektryczność, bo wiadomo że znajdziemy gniazdko, tak w przyszłości będziemy pewni, że po powiedzeniu "Ok, Google" usłyszymy znajomy metaliczny dźwięk.

3. Kontekstowość

Asystent w końcu ma wiedzieć, co jest nieważne, co ważne, a co najważniejsze. Ze sceny zostało to świetnie wytłumaczone w postaci powiadomienia o wizycie u lekarza, które po prostu nie może zginąć w gąszczu lajków i serduszek.

Świadomy swojego kontekstu ma być choćby głośnik z systemem Google Smart Sound. Inaczej ma grać w rogu pomieszczenia, a inaczej na jego środku. Podobnie ze smartfonem, który ma dostosowywać głośność do warunków panujących np. we wnętrzu auta.

4. Uczenie się

Smartfon jest z nami przez cały czas, więc z ogromnej ilości danych powinien wyciągać wnioski o naszych nawykach i preferencjach. Teraz będzie się to działo jeszcze lepiej - oto dwa przykłady.

CEO Google jest wegetarianinem, a Google o tym wie (nie wiem skąd, może ze zdjęć w social media). Asystent będzie mu więc proponował restauracje serwujące bezmięsne dania, a na dodatek podsunie pod nos świetne trasy biegowe do porannego joggingu.

CEO Google nie lubi Kalendarza Google. Głównie przez to, że nie dostosowuje się on do obowiązków w ciągu dnia. W niedzielę powinien przecież pokazywać widok całego tygodnia dla lepszego planowania, a w poniedziałek widok godzinowy, aby doskonale wiedzieć do czego się zabrać i z kim spotkać. Teraz ma tak właśnie być.

Automatyzacja uczenia maszynowego.

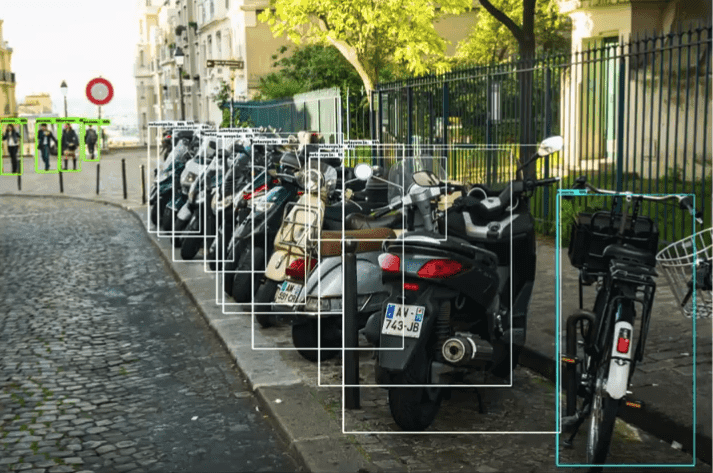

Największą wadą uczenia maszynowego jest fakt, że jest to ono bardzo wąskie. Jeśli zaprogramowaliśmy je do rozpoznawania zdjęć, to będzie się dobrze spisywało tylko w tej dziedzinie.

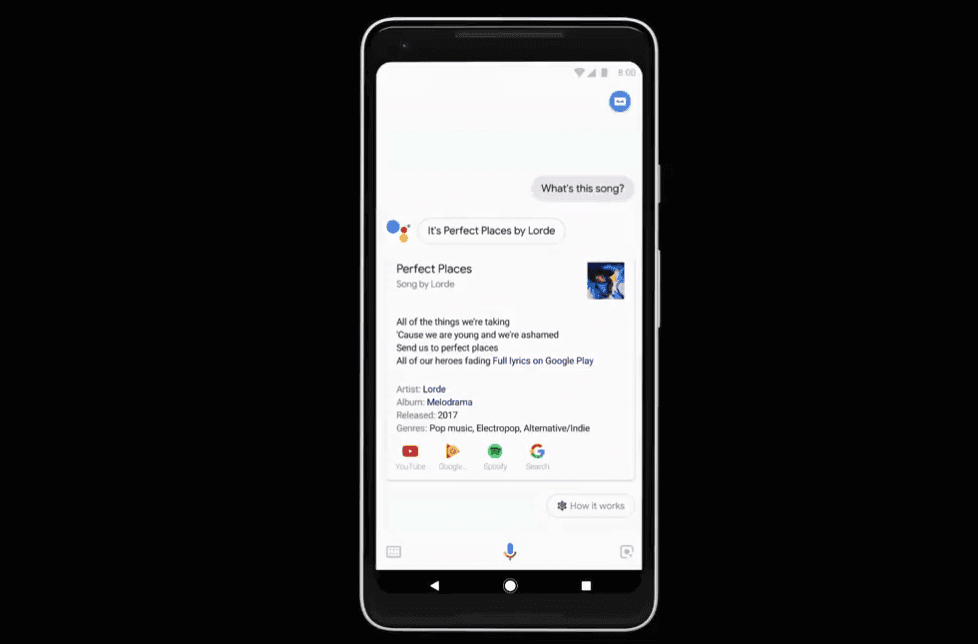

Jeśli zaprogramowaliśmy je do rozpoznawania piosenek, będzie się sprawdzało dobrze tylko w tej dziedzinie.

Każdy taki algorytm musi być zaprojektowany przez człowieka. Albo raczej musiał być. Na tym polega chyba największy przełom, jaki pokazało dziś Google. Kolejne modele uczenia maszynowego generowane są teraz automatycznie - bez ludzkiego pierwiastka.