Po co właściwie w iPhonie 7 Plus podwójny aparat? Nie daj sobie wmówić, że do rozmycia tła

”Podwójny obiektyw sprawia, że smartfon może rozmyć tło”. To kłamstwo zostało powtórzone tyle razy, że wiele osób naprawdę w nie uwierzyło. A jak jest naprawdę?

Użytkownicy iPhone’ów właśnie dostali aktualizację systemu, która nareszcie wprowadza tryb portretowy do iPhone’a 7 Plus. Nowość polega na tym, że aparat potrafi rozmywać tło za fotografowaną osobą lub przedmiotem.

Taką funkcję otrzymał tylko większy iPhone 7 Plus, który jest wyposażony w podwójny obiektyw. Właściciele mniejszej wersji muszą obejść się smakiem. Pytanie brzmi - dlaczego?

Czy do rozmycia tła jest potrzebny podwójny obiektyw?

Jeśli ty też myślisz, że do rozmywania tła jest wymagany smartfon z podwójnym obiektywem, jesteś w błędzie.

Drugi obiektyw zawsze ma jakiś cel:

- w iPhonie 7 Plus ma węższy kąt widzenia,

- w LG G5 ma ultraszeroki kąt,

- w Huawei P9 kąt obu obiektywów jest taki sam, ale różnią się matryce za obiektywami. Dzięki temu aparat dostaje dwa razy więcej danych potrzebnych do redukcji szumu i podrasowania detali.

W żadnym z tych smartfonów podwójny obiektyw nie jest wykorzystywany do rozmywania tła, czyli uzyskiwania tzw. bokeh.

No dobrze, być może tak kategoryczne stwierdzenie jest przesadą. Fakty są jednak takie, że podwójny obiektyw ma marginalny wpływ na efekt rozmycia.

Tak naprawdę za wszystkie „tryby portretowe” w smartfonach odpowiada oprogramowanie, a nie sprzęt. Rola podwójnego obiektywu jest znikoma, lub wręcz żadna.

Producenci smartfonów chcą, byśmy uwierzyli, że dwa obiektywy zbierają więcej danych o tle. Teoretycznie to prawda. W końcu tak też działają nasze oczy.

Przeprowadźmy test: ustaw palec przed swoją twarzą i spójrz na niego najpierw prawym okiem, a później lewym (najlepiej tak, żeby skupić wzrok na tle, a nie na palcu). Palec będzie przeskakiwał na pierwszym panie z lewa na prawo, a tło będzie nieruchome.

To właśnie efekt paralaksy, dzięki któremu nasz mózg jest w stanie tworzyć obrazy przestrzenne. Kiedy patrzymy z dwóch różnych kierunków, jesteśmy w stanie odtworzyć dane o głębi na podstawie różnic w przesunięciach między pierwszym, drugim i każdym kolejnym planem.

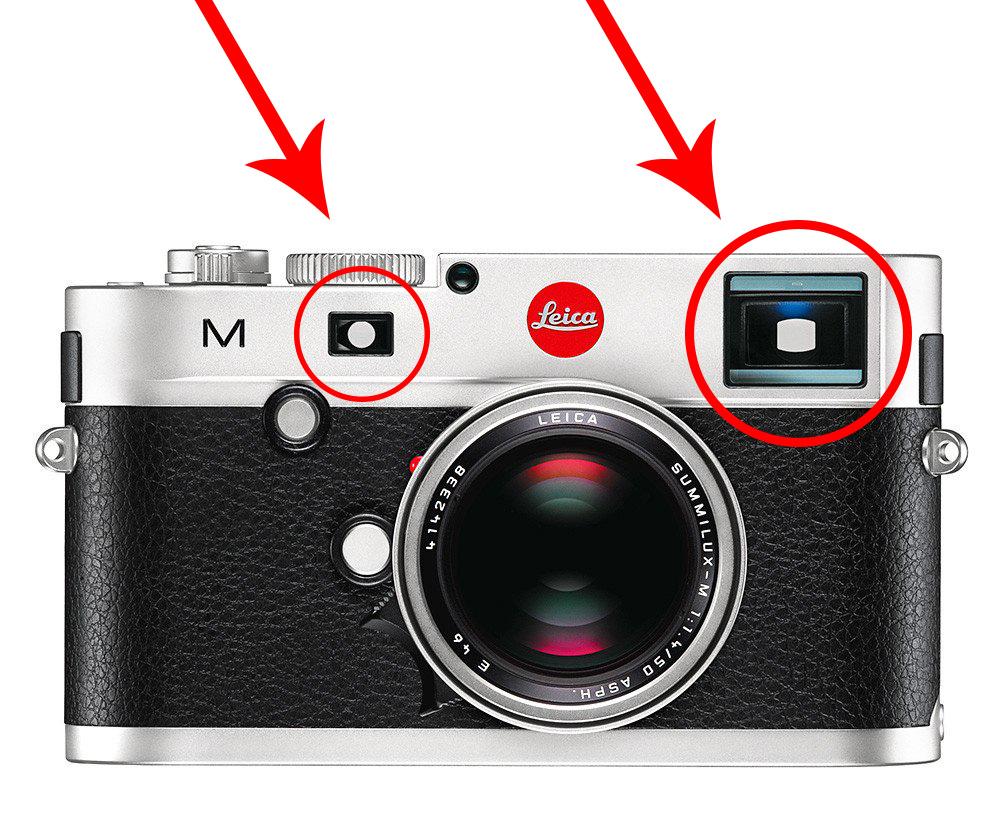

Podobna zasada jest wykorzystywana w aparatach dalmierzowych do ustawiania ostrości. W dużym skrócie: mamy tam dwa okienka, z których oba obrazy wpadają jednocześnie do wizjera. Obrazy są przesunięte względem siebie, ale przesuwając pierścień ostrości możemy ustawić jeden punkt wspólny, czyli płaszczyznę ostrości. Możemy ją ustawić na wybranym planie.

Całość sprowadza się do tego, że odległość między oczami (a także okienkami dalmierza) wynosi kilka centymetrów, a więc jest dość duża.

To pozwala na oszacowanie odległości między planami.

W przypadku smartfonów odległość między dwoma obiektywami to tylko kilka milimetrów, a więc około 20–30 razy mniej, niż w przypadku oczu. To oznacza 20–30 razy mniej danych o głębi obrazu.

W "trybie portretowym" przesunięcie między obrazami z obu obiektywów jest tak małe, że równie dobrze mogłoby go nie być.

Zobaczmy, jak to działa w praktyce, na przykładzie smartfona z podwójnym obiektywem.

Dobrym przykładem będzie aparat w Huawei P9, gdzie oba obiektywy mają ten sam kąt widzenia - tak samo, jak ludzkie oczy.

Aparat tego smartfona pozwala przełączać się między matrycami (a więc i obiektywami). Za jednym obiektywem znajduje się standardowa matryca, a za drugim czarno-biała.

Tak to wygląda w praktyce, kiedy smartfon jest bardzo blisko obiektu na pierwszym planie.

Poniżej znajdziecie zdjęcia wykonane ze statywu, dokładnie z tego samego miejsca. Kadry zostały wykonane dwoma obiektywami Huawei P9.

Faktycznie widać tu efekt paralaksy. Filiżanka z kawą znacznie przesuwa się w kadrze, ponieważ jest bardzo blisko obiektywu. Im dalszy plan, tym mniejsze przesunięcie. Kanapa oddalona ok. 3 metry od smartfona zupełnie się nie porusza, mimo że przecież jest oglądana z (nieco) innego kierunku.

Jednocześnie widać tu, że tło jest rozmyte, i jest to rozmycie spowodowane obiektywem - czysto sprzętowe. Przy tak małych odległościach smartfon mógłby więc rozmywać tło zarówno sprzętowo (co właśnie robi), jak i programowo, ponieważ przesunięcie planów jest zauważalne. Algorytmy powinny poradzić sobie z określeniem głębi tego kadru.

A co, jeśli fotografujemy z odległości portretowej?

Sprawdźmy jak wygląda sytuacja w typowej sytuacji portretowej, kiedy fotografujemy obiekt z odległości np. jednego metra.

Przesunięcia względem obiektywów niemal zupełnie się zacierają. Różnice między kolejnymi planami są bardzo, bardzo małe. Oczywiście można stąd wyciągnąć jakieś dane, ale będzie ich kilkadziesiąt razy mniej, niż w przypadku ludzkich oczu.

To dlatego iPhone 7 Plus realizuje rozmycie za pomocą oprogramowania, a nie podwójnego obiektywu.

Dobrym dowodem na poparcie tej tezy są zdjęcia użytkowników, gdzie ewidentnie widać, że iPhone 7 Plus nie do końca radzi sobie z separacją planów. Świetnie pokazał to Marques Brownlee.

W tym wypadku algorytmy nie były w stanie odróżnić tła od odbicia w szklanej części smartfona. Stąd powstał ten koszmarek. Gdyby iPhone 7 Plus faktycznie używał dwóch obiektywów do separacji tła, efekt byłby lepszy.

Przy fotografowaniu osób najcześciej efekt będzie bardziej naturalny, ale tylko z uwagi na fakt, że algorytmy smartfonów dość sprawnie radzą sobie z wykrywaniem twarzy.

Mimo to, nie ma co liczyć na cuda. Na dzisiejszym etapie rozwoju oprogramowanie nie jest w stanie podrobić rozmycia sprzętowego, generowanego przez obiektyw. Być może za kilka lat smartfony się tego nauczą, ale przed nimi jeszcze długa droga.

A jak to wygląda w Androidzie?

Na koniec warto wspomnieć, jak efekt rozmycia realizują smartfony z Androidem. Na przykład weźmy smartfon Google Pixel, który ma jeden obiektyw. Standardowa aplikacja aparatu ma tryb rozmycia soczewkowego, który działa w ten sposób, że podczas wykonywania zdjęcia musimy przesunąć smartfon o kilka centymetrów do góry.

W ten sposób smartfon symuluje dwa obiektywy, które są od siebie mocno rozsunięte, a dodatkowo ma wszystkie dane pośrednie z pozycji znajdujących się miedzy początkiem a końcem ruchu.

Zalety? Możliwość zasymulowania działania ludzkich oczu. Wady? Metoda jest zupełnie nieskuteczna, jeśli coś porusza się w kadrze. Dodatkowo ruch smartfona w górę musi być płynny i precyzyjny.

Podsumowując - nie bądź podatny na papkę marketingową.

Nie daj sobie wmówić, że do rozmycia tła w trybie portretowym są potrzebne dwa obiektywy. Ten efekt w iPhonie 7 Plus jest realizowany programowo!

Dlaczego w ostatniej aktualizacji systemu iOS tryb portretowy trafił tylko do iPhone 7 Plus? Prawdopodobnie z tego samego względu, dla którego w poprzedniej generacji iPhone’a stabilizacja optyczna była dostępna tylko w wersji 6s Plus. A - jak widać na przykładzie małego iPhone’a 7 - stabilizacja z powodzeniem mieści się także w mniejszej obudowie.