Google udostępnił za darmo zaawansowany system rozpoznawania obrazów

Każdy, kto korzystał z Google Photos lub choćby z wyszukiwarki obrazów Google Images, wie, że usługi te korzystają z niezłych algorytmów rozpoznających obrazy.

Fotografie i obrazy w tych usługach możemy wyszukiwać nie tylko po opisach, ale i po zawartości (np. "krajobraz", "jezioro", "wieża Eiffela") jak również po konkretnych cechach zdjęcia (dominujący kolor, lub rozmiar).

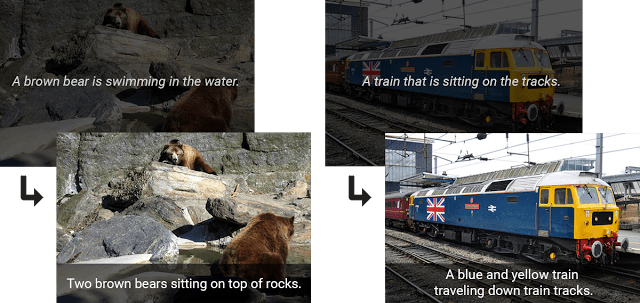

Zastosowane do tego celu technologie powstały na miejscu w Google. Zespół zajmujący się trenowaniem sztucznej inteligencji opisującej obrazy działa pod kryptonimem Google Brain, i zaprezentował już swoje osiągnięcia w 2014 roku, pokazując program opisujący poprawnie prawie każde zdjęcie. W 2015 roku algorytm ten zdobył drugie miejsce w konkursie Common Objects In Context zorganizowanym przez Microsoft.

Kto zdobył w 2015 roku pierwsze miejsce? Naturalna sieć neuronowa zawarta w ludzkiej głowie. Człowieka umieszczono w konkurencji dla porównania, bo niewykluczone jest osiągnięcie poziomu dokładności opisywania zdjęć lepszego od człowieka.

Od tego czasu programiści Google nie przestawali pracować nad swoim algorytmem. Był on cały czas usprawniany, tak aby odróżnić jak najwięcej obiektów umieszczonych na zdjęciach. Dziś udostępniają go zaś za darmo - w ramach większego projektu zajmującego się uczeniem maszynowym o nazwie TensorFlow. Oprócz Google, rozwiązań z TensorFlow używają również takie firmy jak SnapChat.

Prezentowany w 2014 roku algorytm używał metody klasyfikacji obrazów ochrzczonej przez inżynierów Google jako Inception V1. Jego skuteczność wynosiła 89,6%. Kod, który został dziś nieodpłatnie udostępniony jest już o dwie wersje bardziej zaawansowany - to Inception V3, ze skutecznością wynoszącą 93,9%.

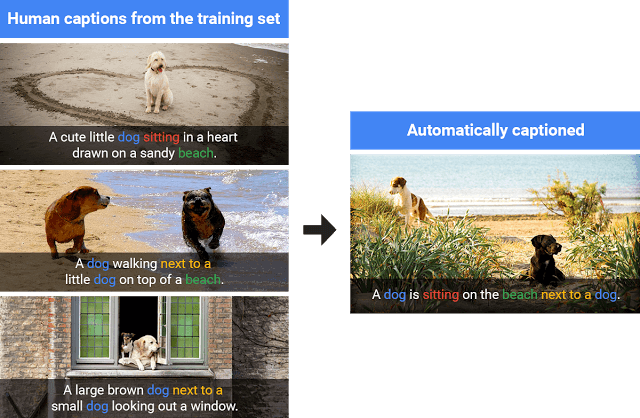

W tej wersji programiści skupili się na prawidłowych i naturalnie brzmiących opisach. Nie wystarczy stwierdzić, że na fotografii występuje plaża, pies i piłka. Należy wygenerować zdanie, które zgrabnie to opisze, podając również relacje pomiędzy obiektami (na przykład: Brązowy pies biegnie po plaży za piłką).

Chętni mogą już dziś pobawić się nowym algorytmem, a nawet użyć go w swoich aplikacjach. Pamiętajmy jednak, że nie jest to tradycyjna, gotowa to użycia aplikacja: jest to system uczący się, który należy wytrenować. Przykłady, jak można to zrobić, umieszczono na stronie GitHub projektu.