Sprawdzałeś na zdjęciach ile masz lat? Oto dzięki jakim technologiom było to możliwe

Jeśli w zeszłym tygodniu korzystałeś z urządzenia podłączonego do Internetu, na pewno widziałeś how-old.net - stronę, która analizowała fotografię i oceniała "na ile lat wyglądasz". Linki do tej strony, oraz wyniki analizy fotografii przekazywano sobie w mediach społecznościowych bardzo powszechnie, i nie sposób było się opędzić od wrażenia, że wszyscy się tym fascynują.

Po pierwszej fali fascynacji rozpoczęła się (równie krótka, jak to w erze Internetu), fala buntu - analizowano na wszelkie sposoby towarzyszący stronie regulamin, i doszukiwano się w nim ukrytych złych intencji. Być może Microsoft stworzył tę stronę, aby ukraść nam zdjęcia?! Nie zabrakło takich, którzy wrzucali tam fotografie znanych ludzi, dochodząc do zaskakujących wniosków (kobiety aktorki się nie starzeją, a gwiazdy filmów dla dorosłych starzeją się szybciej). Twitter został zalany zanalizowanymi fotografiami wysłanymi z aplikacji z hashtagiem #HowOldRobot

Prościutka aplikacja przemawiała do naszego poczucia własnej wartości. Dawała nam możliwość pochwalenia się, gdy robot uznał nas za młodszych niż w rzeczywistości, i pożalenia się, gdy nas postarzył. W sumie nie miało większego znaczenia, czy zgadł dobrze czy źle.

Co stoi za tą niebywałą popularnością prostego dema, zaprezentowanego po raz pierwszy na konferencji Build 2015 jako przykład użycia nowego zestawu usług dla programistów?

Jest to jedna z testowych aplikacji zestawu usług dla programistów (API - Application Programming Interface), zebranych pod kodową nazwą Project Oxford. Zawiera on bardzo proste w obsłudze usługi, które pozwolą wzbogacić pisane aplikacje między innymi o funkcjonalność rozpoznawania twarzy czy analizę obrazów. Dodanie jej do własnego programu jest bardzo proste, a Microsoft zadbał o odpowiednie SDK dla piszących w różnych środowiskach.

Usługi te zbudowano w oparciu o istniejące już komponenty ekosystemu Microsoft: z użyciem wyszukiwarki Bing (i jej nowego silnika Image Graph, który "rozumie" zawartość obrazków) i serwerów Azure ML (Machine Learning), zapewniających zdolności analityczne.

Nowe usługi zebrane pod zbiorczą nazwą Project Oxford to:

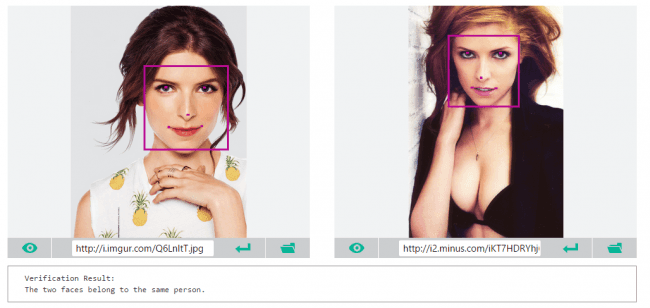

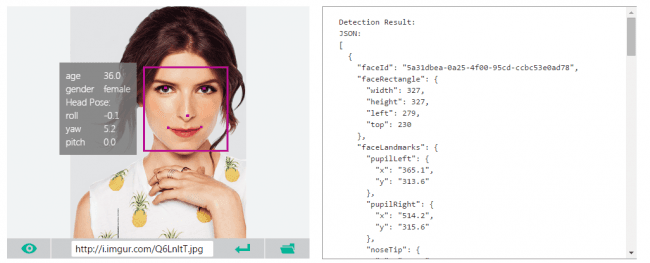

Face API - umożliwiająca odnajdywanie na obrazkach twarzy i ustalania jej parametrów (punktów typu krawędzie ust, oczu etc). Oprócz tak zwanej "mapy twarzy" otrzymujemy (za pomocą formatu JSON) informacje o płci i domniemanym wieku osoby przedstawionej na fotografii.

Speech API - udostępnia rozpoznawanie mowy i syntezę mowy, obie te funkcje pochodzą z Bing.

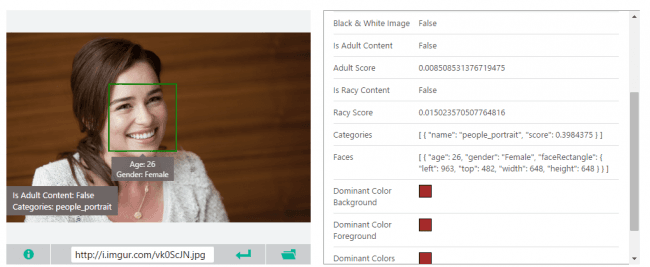

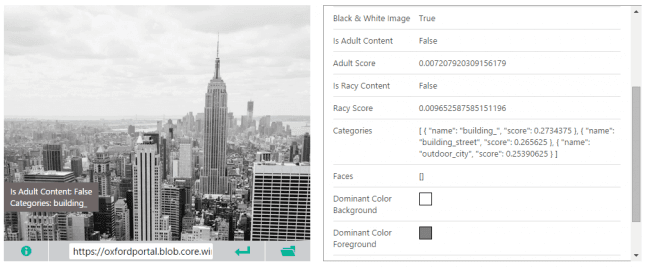

Vision API - pozwala na analizę obrazów - rozpoznaje m.in. podstawowe kategorie obrazu (typu "grupa ludzi", "pojazd", "człowiek uprawiający sport"), i kilka innych parametrów jak podstawowe kolory, czy fakt, że fotografia zawiera "treści dla dorosłych" czyli po prostu goliznę. Dodatkowo, możemy "wyciągnąć" z fotografii czy rysunku znajdujący się na niej tekst.

Language Understanding Intelligent Service - dostępna na razie jedynie za zaproszeniem usługa, pozwalająca na wydawanie aplikacji poleceń w języku naturalnym.

Każdy programista może się zapisać do czterech pierwszych usług, i otrzymać klucz, który potem będzie używany w zapytaniach do serwera. Niestety, w tej chwili serwery umożliwiające rejestrację są przeciążone.

Na stronie projektu Oxford możemy zobaczyć kilka dem do każdej z usług, jak również ściągnąć biblioteki dla programistów i przykładowe projekty (w JavaScript i C#).

* Zdjęcie główne pochodzi z serwisu Shutterstock.